Donna vittima di stalking fa causa a OpenAI, accusa ChatGPT di aver alimentato le illusioni dell’ex.

Risposte e preoccupazioni legali crescenti

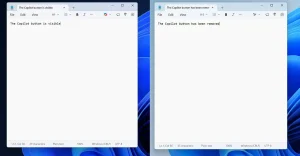

OpenAI ha accettato di sospendere l’account dell’utente, ma ha rifiutato le richieste di ulteriori misure, secondo gli avvocati di Doe. Questi sostengono che l’azienda stia trattenendo informazioni su piani specifici che l’utente potrebbe aver discusso con ChatGPT per nuocere a Doe e ad altre possibili vittime.

Questa causa legale arriva in un momento di crescente preoccupazione riguardo ai rischi reali legati ai sistemi di intelligenza artificiale. GPT-4o, il modello menzionato in questa e in molte altre cause, è stato ritirato da ChatGPT nel febbraio 2024. La causa è condotta da Edelson PC, lo studio legale che ha gestito le azioni legali per morte ingiusta nei casi del teenager Adam Raine, morto per suicidio dopo aver interagito con ChatGPT, e di Jonathan Gavalas, la cui famiglia sostiene che Gemini di Google abbia alimentato le sue delusioni prima della sua morte.

Il lead attorney Jay Edelson ha messo in guardia sul fatto che la psicosi indotta dall’IA sta evolvendo da danni individuali a potenziali eventi di massa. Questa pressione legale si scontra direttamente con la strategia legislativa di OpenAI, che sta sostenendo una legge dell’Illinois che proteggerebbe i laboratori di IA da responsabilità anche in casi di morti di massa o danni finanziari catastrofici.