Anthropic accusa i laboratori cinesi di sfruttare Claude mentre gli USA discutono le esportazioni di chip AI.

Anthropic accusa tre aziende cinesi di furto di dati da AI

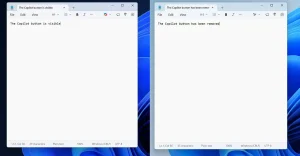

Anthropic ha lanciato accuse contro tre compagnie cinesi specializzate in intelligenza artificiale, sostenendo che abbiano creato oltre 24.000 account falsi utilizzando il suo modello di AI, Claude, per migliorare i loro stessi algoritmi. Le aziende coinvolte sono DeepSeek, Moonshot AI e MiniMax, le quali si suppone abbiano generato più di 16 milioni di scambi con Claude attraverso questi account, adottando una tecnica nota come “distillazione”.

I dettagli delle accuse

Anthropic ha affermato che le aziende hanno mirato alle capacità distintive di Claude, come il ragionamento agentico, l’uso di strumenti e la programmazione. Queste accuse giungono in un contesto di dibattito sulle misure di controllo alle esportazioni dei chip avanzati per l’AI, una politica che mira a limitare lo sviluppo dell’AI in Cina.

La distillazione è un metodo di addestramento frequentemente utilizzato nei laboratori di intelligenza artificiale per sviluppare versioni più piccole e economiche dei modelli esistenti. Tuttavia, se usato in modo scorretto, può anche consentire ai concorrenti di copiare il lavoro di altre aziende. Recentemente, OpenAI ha accusato DeepSeek di utilizzare la distillazione per imitare i suoi prodotti.

DeepSeek e il suo modello open-source

DeepSeek ha attirato l’attenzione oltre un anno fa, quando ha presentato il suo modello di ragionamento open-source R1, che ha dimostrato di eguagliare le prestazioni dei laboratori americani a un costo molto ridotto. In aggiunta, è previsto che DeepSeek rilasci a breve DeepSeek V4, il suo ultimo modello, che dovrebbe superare le capacità di Claude di Anthropic e di ChatGPT di OpenAI nella programmazione.

La portata delle operazioni delle aziende cinesi

Le operazioni delle tre aziende variano notevolmente in termini di scala e obiettivi specifici. Anthropic ha monitorato oltre 150.000 interazioni da DeepSeek, indirizzate al miglioramento della logica di base e dell’allineamento, specialmente per quanto riguarda le alternative sicure ai filtri di contenuti sensibili. Moonshot AI ha registrato più di 3,4 milioni di scambi mirati a sviluppare ragionamento agentico, utilizzo di strumenti, analisi dei dati e visione computerizzata. La scorsa settimana, l’azienda ha lanciato un nuovo modello open-source, Kimi K2.5, accompagnato da un agent di programmazione.

MiniMax, d’altra parte, ha svolto oltre 13 milioni di interazioni focalizzandosi su codifica agentica, utilizzo di strumenti e orchestrazione. Anthropic ha osservato che MiniMax ha diretto quasi metà del proprio traffico per sfruttare le capacità del nuovo modello Claude al momento del suo lancio.

Anthropic ha confermato di voler continuare a investire in difese per rendere più difficili e identificabili questi attacchi di distillazione. L’azienda ha chiesto una risposta coordinata tra le industrie dell’AI, i fornitori di servizi cloud e i responsabili politici.

Il dibattito sulle esportazioni di chip

Le accuse di distillazione arrivano in un periodo in cui le esportazioni di chip americani verso la Cina sono oggetto di accesi dibattiti. Di recente, l’amministrazione Trump ha autorizzato ufficialmente aziende statunitensi come Nvidia a esportare chip avanzati per l’AI, come l’H200, in Cina. Critici avvertono che questa riduzione dei controlli sulle esportazioni aumenti la capacità di calcolo dell’AI in Cina, in un momento cruciale nella corsa globale all’egemonia in questo campo.

Anthropic sottolinea che la scala delle operazioni condotte da DeepSeek, MiniMax e Moonshot richiede l’accesso a chip avanzati. Secondo il blog di Anthropic, “gli attacchi di distillazione rafforzano quindi la motivazione a imporre controlli all’esportazione: limitare l’accesso ai chip riduce sia l’addestramento diretto dei modelli che la scala della distillazione illecita”.

Dmitri Alperovitch, presidente del think tank Silverado Policy Accelerator e cofondatore di CrowdStrike, ha affermato a TechCrunch di non essere sorpreso da queste notizie: “È chiaro da tempo che parte del motivo per cui i modelli cinesi di AI stanno progredendo così rapidamente è il furto attraverso la distillazione dei modelli di frontiera statunitensi. Ora abbiamo la conferma di questo fatto.”

Anthropic ha anche evidenziato che la distillazione non minaccia solo la supremazia americana nell’AI, ma rappresenta anche un potenziale rischio per la sicurezza nazionale. “Anthony e altre aziende statunitensi sviluppano sistemi per impedire che attori statali e non statali utilizzino l’AI per, ad esempio, sviluppare armi biologiche o condurre attività informatiche malevole,” si legge nel loro comunicato.

Fonti ufficiali: